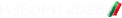

Видеата, направени с т.нар. дийпфейк технология - когато реално и фалшиво се сливат в едно, не са феномен, случващ се само със световни публични личности.

През последните месеци и български политици станаха жертви на дийпфейк (дълбока фалшификация – бел. ред.).

Първо премиерът Николай Денков, за когото се внушаваше невярно, че събира лични данни.

След това и президентът Румен Радев - като част от неистинска реклама на „Лукойл“.

Преди дни и бившият премиер Кирил Петков. Той попадна в 3-минутно видео с лица на bTV. Този път с призив за инвестиции в приложение за бързи печалби, уж управлявано от Илън Мъск.

Използвани са реални кадри от гостуване на Кирил Петков в "Лице в лице", както и от емисия на bTV Новините.

„Целта е една-единствена - да може да се злоупотреби с доверието на потребителите, да бъдат финансово ощетени, да се тества доколко те са запознати с тази технология, дали могат да оценят истината от лъжата. За съжаление, едно от последните проучвания на ЕС доказа, че обществото в България е най-податливо на лъжлива информация, на дезинформация“, обясни експертът по киберсигурност Любомир Тулев.

Качеството на разпространяваните дийпфейк видеа е различно.

„Някои са доста добри, а други - не толкова. Това се дължи на различните платформи, които се използват - дали са безплатни или платени, тъй като в момента съществуват може би стотици платформи, на които чрез изкуствен интелект да направиш т.нар. обръщане на лицата или дийпфейк видео“, добави той.

Един от знаците на фалшифицираните видеа е, че качеството на картината е лошо. Има и разминавания в говора.

„Аудио и видео технически непременно има белези, по които да открием дали това видео е дийпфейк видео, или не. Трябва да разбием проблема на две части - едното е синтезът на речта, като част от процеса, а другият е наслагването на т.нар. „липсинг“ или синхронизиране на устни. Типично за синтеза на речта - може би, ако се сещате и от предишни дийпфейк видеа, които сме виждали в интернет на български политици, думите, които произнасят около числа и дори самите числа, не звучат чисто, не звучат естествено“, обясни Мартин Стаменов, експерт по изкуствен интелект.

„В контекста на предстоящите избори - както в Европа, така и в САЩ, представете си ситуацията от 2019 с "Кеймбридж Аналитика“ - скандалът, когато се използваха нагласите на американското общество. И сега върху това цялото нещо добавим и изкуствен интелект, колко много по-големи могат да бъдат последствията. Така че наистина интересни времена предстоят тази година“, допълни Любомир Тулев.