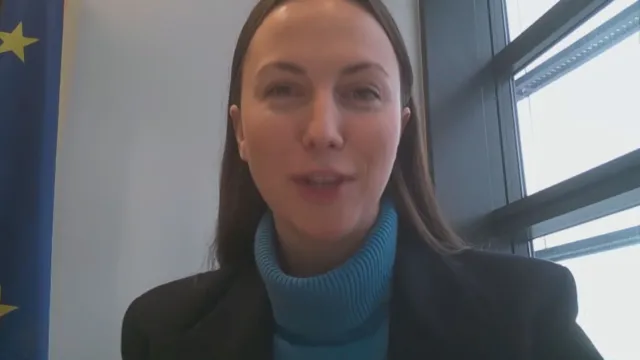

Европейският съюз (ЕС) одобри първия в света закон, който да регулира изкуствения интелект (AI) Българският евродепутат Ева Майдел е един от докладичиците и част от екипа, водил преговорите в продължение на 40 часа.

Защо е важно AI да бъде контролиран и може ли да бъде опасен - отговорите в интервюто с Майдел в „120 минути“.

Липсата на контрол при зараждането на социалните мрежи роди техники за глобална манипулация и много опасности за обществата. В този смисъл, защо AI трябва да се регулира?

„Изкуственият интелект вече не е тема само за научни и технологични форуми или само за експерти. Вярваме, че това е технология, която се използва от всеки гражданин, всеки бизнес, в нашите автомобили и трябва все по-често да бъде широко обсъждана. Изкуственият интелект от една страна може да се използва за масовото следене на граждани, но от друга – да предоставя много конкретни диагнози в медицината или в биотехнологиите. Например, за неща, които са в помощ на обществото, но и такива, които могат сериозно да навредят. Затова беше много важно ЕС да приеме своя правна рамка как и какво искаме да постигнем, за да дадем посока какво може и какво не. Можем да си представим свят, в който всяка камера може да ви разпознава и следи, в който фалшивите новини и видеа изпълват изцяло социалните ни мрежи, в който изкуственият интелект определя дали сте наети на определена работа, или детето ви е прието, или не в определен университет. Когато питате тази система, тя да не може да ви даде отговор. С този закон казваме, че не искаме да живеем в такъв свят“.

Ще бъде ли регулирано лицевото разпознаване чрез изкуствен интелект в европейските градове?

„В този закон имаме много ясни и строги ограничения изкуственият интелект да не се използва за следене на хора и да не нарушава нашите граждански права. Например – искаме да използваме лицево разпознаване в подобни случаи, това няма да бъде възможно. Но ако има отвлечено дете, заподозрян терорист или престъпник, искаме тези системи да могат да ни помогнат в такива определени крайни случаи. Не искаме тези системи да ни следят непрекъснато през нашия живот и точно това успяхме да постигнем с този регламент и имаме политическо споразумение за това как да регулираме тази част на технологията“.

Забранява се използването в социалната, кредитна система, както и за манипулиране или използване на уязвимостите на потребителите. Може ли да дадете пример?

„Има страни, в които изкуственият интелект се използва не в полза на обществото, а в полза на авторитарния режим. В Китай тази технология се използва именно за този тип социална, кредитна система. На базата на информация, събрана от различни камери, интернет история, поведение на публични места Китай използва изкуствения интелект, за да оцени т.нар. „лоялност“ на определен човек или компания и какъв риск имат. Тоест, ако забавиш плащането на наема си, може властите да не ти позволяват да се качиш на градски транспорт, ако критикуваш правителството в интернет, можеш да получиш по-високи данъци. Ние сме категорично против в Европа за този вид използване на изкуствения интелект и го забраняваме в регламента“.

В момента чатботовете с изкуствен интелект дават грешни отговори за много хора и събития, според това с каква информация се захранват. Опасявате ли се, че това може да бъде следващата голяма вълна на фалшиви новини и как ще го регулирате?

„Правим това в регламента. В момента този тип чатботове се използват от около 150 млн. души в цял свят. Ако има грешка в тях, тя би се разпространила и мултиплицирала и за обществото и това би създало сериозни проблеми. Затова слагаме ясни, строги правила - първо данните да бъдат обучени по определени правила, след това да се въведат много високи нива на киберсигурност и да има хора, които следят как се справя този чатбот и дали въобще върши работа. Също така при всяко наше взаимодействие с чатбот трябва да знаем, че имаме такова. Това също се предвижда в закона“.

Как обаче този закон ще се прилага, всяка държава членка сама ще го прилага, както GDPR, или Брюксел ще го прилага за всички?

„Законът ще се прилага по два начина. Едната част – на национално ниво. Тук става въпрос за т.нар. „високорискови сфери“, които ще подлежат на стриктен контрол. Например, когато изкуственият интелект се използва в банковото дело, от университети, училища, за наемане на хора в социалната сфера. Там националните институции ще имат малко повече правомощия. В същото време ние много добре разбираме, че тази технология е далеч по-сложна от всяка една и има много малко хора по света, които истински я разбират и могат да проверят и прилагат тези нови правила. Затова ЕК ще създаде специален офис, който ще се ситуира в ЕК, който да може да подпомага работата и да бъде в непрекъснат контакт с компаниите, за да види дали тази регулация се прилага. Ще има и доста сериозни глоби, ако не се прилага“.